Que mettre à l'entrée du réseau neuronal ? Vos idées... - page 31

Vous manquez des opportunités de trading :

- Applications de trading gratuites

- Plus de 8 000 signaux à copier

- Actualités économiques pour explorer les marchés financiers

Inscription

Se connecter

Vous acceptez la politique du site Web et les conditions d'utilisation

Si vous n'avez pas de compte, veuillez vous inscrire

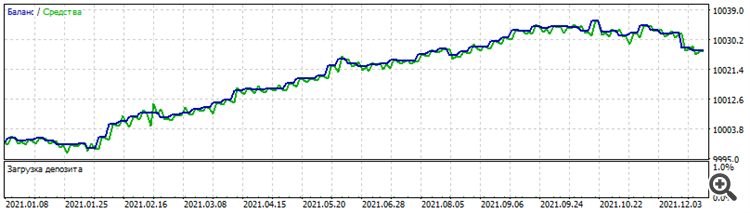

En guise de confirmation, mes graphiques ci-dessus. Une entrée, deux entrées, trois entrées - un neurone, deux neurones, trois neurones. Voilà, la prochaine étape est le réentraînement - mémoriser le chemin, ne pas travailler sur de nouvelles données.

Il en va de même pour les modèles en bois. Avec 3 à 5 (peut-être jusqu'à 10, mais plus probablement jusqu'à 5) entrées/caractéristiques, le modèle peut encore montrer un bénéfice sur le parcours, s'il y en a plus, il est déjà aléatoire ou en perte de vitesse, c'est-à-dire qu'il faut se recycler.

Ces 3 à 5 meilleurs jetons ont été obtenus par une recherche complète de paires, de trois, etc. et par l'entraînement de modèles sur ces jetons et la sélection des meilleurs sur le forward de valorisation.

I van Butko #:

Imaginez qu'un réseau neuronal ordinaire prenne chaque nombre, chaque caractéristique - et les additionne stupidement, multipliés par le poids, en un tas d'ordures, appelé additionneur.

Les arbres utilisent également la moyenne des feuilles. S'il s'agit d'une forêt, elle fait la moyenne avec d'autres arbres, s'il s'agit d'un buisson, elle fait la synthèse avec les autres arbres. En d'autres termes, la situation est la même avec les réseaux neuronaux qu'avec les modèles d'arbres. Il s'agit d'une moyenne. Lorsqu'il y a beaucoup de bruit, il est possible de s'entraîner normalement sur 3 à 5 puces seulement.

Le calcul de la moyenne avec du bruit est un recyclage sur du bruit. P.S. Au lieu d'utiliser NeuroPro, vieux de plus de 20 ans, vous pouvez utiliser quelque chose de plus récent. R, Python, ou s'il est difficile de les utiliser, utiliser l'EXE de Catbusta, comme icihttps://www.mql5.com/ru/articles/8657 Vous pouvez exécuter automatiquement l'EXE directement à partir de l'EA, c'est à dire automatiser complètement le processus.

Exemple http s://www.mql5.com/ru/forum/86386/page3282#comment_49771059 P.P.S. Il vaut mieux dormir la nuit. Vous ne pouvez pas acheter votre santé, même si vous gagnez des millions sur ces réseaux.

Il en va de même pour les modèles en bois. Avec 3 à 5 (peut-être jusqu'à 10, mais plus probablement jusqu'à 5) entrées/caractéristiques, le modèle peut encore montrer un bénéfice sur la marche avant, s'il y en a plus, c'est qu'il est déjà aléatoire ou qu'il a pris de la prune, c'est-à-dire qu'il faut le réentraîner.

Ces 3 à 5 meilleures fichas ont été obtenues par une recherche complète de paires, de trois, etc. et par l'entraînement de modèles sur celles-ci et la sélection des meilleurs sur le jacking forward.

Les arbres utilisent également la valeur moyenne des feuilles. S'il s'agit d'une forêt, la moyenne est calculée avec d'autres arbres, s'il s'agit d'un buisson, la moyenne est calculée avec des arbres en cours d'affinage. En d'autres termes, la situation est la même avec les réseaux neuronaux qu'avec les modèles d'arbres. Tous les calculs se font en moyenne. Lorsqu'il y a beaucoup de bruit, il n'est possible de s'entraîner normalement que sur 3 à 5 puces.

Le calcul de la moyenne avec du bruit est un recyclage sur du bruit. P.S. Au lieu d'utiliser NeuroPro, vieux de plus de 20 ans, vous pouvez utiliser quelque chose de plus récent. R, Python, ou s'il est difficile de les utiliser, utiliser l'EXE de Catbusta, comme icihttps://www.mql5.com/ru/articles/8657 Vous pouvez exécuter automatiquement l'EXE directement à partir de l'EA, c'est à dire automatiser complètement le processus.

Exemple http s://www.mql5.com/ru/forum/86386/page3282#comment_49771059 P.P.S. Il vaut mieux dormir la nuit. Vous ne pouvez pas acheter votre santé, même si vous gagnez des millions sur ces réseaux.

Merci pour cet article

Pour moi, le graal ne réside pas dans l'addition, mais dans la division du nombre

UPD

Et la tâche des neurones n'est pas d'obtenir un ensemble de nombres, mais d'obtenir un nombre en entrée. Il faut le multiplier par un poids et le faire passer par une fonction non linéaire.

En d'autres termes, il y a un nombre (valeur d'entrée, ou sortie du neurone), et ce nombre est divisé par deux neurones ou plus de la couche suivante.

Ils doivent être indépendants des autres neurones. Il s'agit d'un département qui fait son propre travail. Ensuite, tous ces départements doivent rendre compte à un patron - le neurone de sortie. Il tire une conclusion basée sur les sorties de tous les neurones finaux. Avec ses propres poids.

De cette manière, nous réduisons la distorsion de l'information et augmentons sa lecture.

Le graal que je vois n'est pas la sommation, mais la division des nombres.

Les feuilles sont obtenues en divisant les données, même en 1000000 parties/feuilles différentes, mais le résultat/la réponse d'une feuille est la moyenne des exemples/rangées qu'elle contient.

Mais le résultat/la réponse d'une feuille est la moyenne des exemples/rangées qu'elle contient. La division existe donc, mais la sommation aussi. On peut se limiter à un seul exemple dans une feuille, mais c'est un surentraînement à 100 % dans le bruit. Les arbres également soumis au bruit ne devraient pas se diviser profondément, pour une bonne progression (c'est ainsi que le nombre de neurones est meilleur - petit).

Je suis tombé sur ce que l'on appelle le spread et la commission.

Merci MT5, vous savez comment vous dégriser. J'aurais dû passer de MT4 à vous il y a longtemps.

@ Andrey Dik avait raison il y a de nombreuses années - le graal se trouve toujours autour du spread et de la commission. Dès que vous les supprimez, le réseau neuronal continue à avancer.

Les feuilles sont obtenues en divisant les données en 1000000 parties/feuilles différentes, mais le résultat/la réponse d'une feuille est la moyenne des exemples/rangées qu'elle contient.

Mais le résultat/la réponse d'une feuille est la moyenne des exemples/rangées qu'elle contient. Il y a donc un découpage, mais aussi un résumé. On peut se limiter à un seul exemple dans une feuille, mais c'est un surentraînement à 100 % en raison du bruit. Les arbres également soumis au bruit ne devraient pas se diviser profondément, pour une bonne progression (c'est ainsi que le nombre de neurones est meilleur - petit).

Quel vaste sujet ! Je vais maintenant googler les feuilles. Dans environ 5 ans, j'atteindrai la branche MO, mais je ne la relirai pas.

Je suis passé de Toyota à une vieille voiture de sport Comme MT5 est limité dans le nombre de paramètres optimisables, je suis passé à NeuroPro 1999, à partir de l'article ici -Neural Networks for free and easy - connecting NeuroPro and MetaTrader 5 (Réseaux neuronaux gratuits et faciles).

J'ai augmenté l'architecture en quantité : dans MT5 c'était 5-5-5-5, et ici c'est 10-10-10, et l'entraînement est déjà réel (pour être plus précis - standard, par la méthode de rétropropagation des erreurs et d'autres caractéristiques internes au programme. Son auteur s'en moque et ne va même pas mettre à jour la rareté - d'après ses réponses à mes questions, il n'a aucun intérêt à développer NeoroPro, à introduire le multithreading, les méthodes modernes, etc.

Je suis tombé sur ce que l'on appelle le spread et la commission.

Merci MT5, vous savez comment dégriser. J'aurais dû passer de MT4 à MT5 il y a longtemps.

@ Andrey Dik avait raison il y a de nombreuses années - le graal se trouve toujours autour du spread et de la commission. Dès que vous les supprimez, le réseau neuronal continue à avancer.

L'entraînement sur l'architecture "extension", lorsque la première couche est composée de 1 neurone, puis la deuxième couche de 2, la troisième couche de 3, etc. a donné un ensemble aussi amusant que curieux : les résultats de l'ensemble sur la période d'optimisation EURUSD sont exactement les mêmes sur les autres paires de dollars : Optimisation pour 2021 sur EURUSD

Test sur GBPUSD pour 2021

Test sur AUDUSD pour 2021

Test sur NZDUSD pour 2021

Pourquoi seulement les curieux ? Parce que c'est un dead set, ça ne marche ni avant ni après. Mais, le fait même qu'il fonctionne sur plusieurs paires de dollars sur la même période, étant donné que bien qu'il y ait une certaine corrélation entre eux, le pricing de chaque paire est encoredifférent.

L'entraînement sur l'architecture "extension", lorsque la première couche consiste en 1 neurone, puis la 2ème couche en 2, la 3ème couche en 3, etc. a donné un ensemble aussi amusant que curieux : Les résultats de l'ensemble sur la période d'optimisation EURUSD sont exactement les mêmes sur les autres paires de dollars : Optimisation pour 2021 sur EURUSD.

Test sur GBPUSD pour 2021

Test sur AUDUSD pour 2021 Test sur NZDUSD pour 2021 Pourquoi seulement les curieux ? Oui parce que c'est un dead set, ça ne marche ni avant ni après. Mais, le fait même qu'il fonctionne sur plusieurs paires de dollars sur la même période, étant donné que bien qu'il y ait une certaine corrélation entre eux, le pricing de chaque paire est toujoursdifférent.

Non, elle est différente.

Sur toutes les paires, à l'exception de l'euro, un tiers du solde à la fin se trouve au même endroit.