Estatísticas de dependência entre aspas (teoria da informação, correlação e outros métodos de seleção de características) - página 15

Você está perdendo oportunidades de negociação:

- Aplicativos de negociação gratuitos

- 8 000+ sinais para cópia

- Notícias econômicas para análise dos mercados financeiros

Registro

Login

Você concorda com a política do site e com os termos de uso

Se você não tem uma conta, por favor registre-se

As pessoas que têm EViews não fazem tais perguntas, hee-hee

Você teria a gentileza de me enviar, seja em particular ou aqui, EViews, se possível?

As pessoas que têm EViews não fazem tais perguntas, heehehee

Bem, sim, é uma pergunta tola, eu concordo. As garantias são as mesmas que o modelo em si.

Qual versão você tem? Dizem que os 5 estão desatualizados.

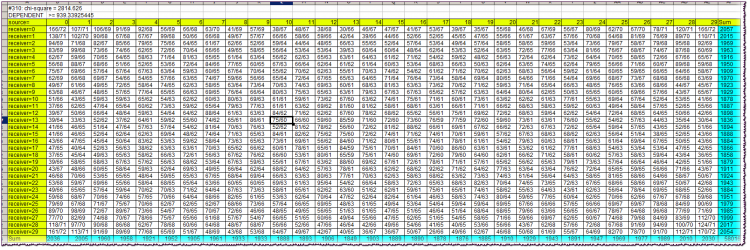

Primeira linha do bloco: #310: qui-quadrado = 2814.626Primeiro - o valor da variável Lag. Depois o valor qui-quadrado da independência das variáveis.

Segunda linha: conclusão de dependência/independência, juntamente com o valor do limite do qui-quadrado.

As células amarelas na tabela são tampas. Eles permitem orientar quais caracteres do alfabeto foram observados simultaneamente na intersecção da linha e coluna correspondentes. Recordar que os alfabetos na fonte e no receptor são idênticos e iguais aos quantis nos quais os retornos das barras correspondentes (fonte e receptor) caíram.

Por exemplo, na intersecção da fonte da coluna=10 e do receptor da linha=13 encontramos um valor de célula de 75/60. Isto significa que a combinação "o retorno da fonte (barra no passado) capturada no 10º quantil e o retorno do receptor (barra mais próxima do presente) capturada no 13º quantil" foi observada 75 vezes na história, com o número teórico de tais combinações sendo 60 se fossem independentes.

As células turquesa são as somas das freqüências reais por linha ou coluna, necessárias para calcular o qui-quadrado.

O próprio qui-quadrado no caso da independência da fonte e do receptor deve ser quase sempre menor que o limite, ou seja, especificado na segunda linha do bloco. Como podemos ver, é muito maior, quase 3 vezes maior. Isto indica uma dependência de barras muito forte neste caso.

O arquivo inteiro, mesmo arquivado, ocupa muito espaço, por isso não posso colocá-lo aqui.

Bem, sim, é uma pergunta tola, eu concordo. As garantias são as mesmas que para o modelo em si.

Qual versão você está executando? Dizem que os 5 estão desatualizados.

Existe a definição Shannon de entropia, na qual a independência é obrigatória.

E há uma definição de informação mútua, na qual a definição de Shannon é aplicada de forma puramente formal, já que ainda se supõe que existem dependências.

Se você quiser aprofundar a profundidade filosófica e as contradições da definição de informação mútua - por favor, escave. Prefiro não me preocupar com isso e apenas usar a fórmula "americana" com probabilidades, sem me preocupar com independência.

Um pouco de erro de nome. A tradução dos significados da casca..., TI é a seguinte. Existe um conceito de entropia. Deve-se entender claramente que por trás desta bela e incompreensível palavra estrangeira existe uma figura artificialmente inventada. Nos livros didáticos, aqueles que são mais honestos, é escrito diretamente, uma medida axiomaticamente introduzida de incerteza. Como isso se revela é na verdade uma convolução. Grosso modo, uma grande tabela descrevendo os estados e suas frequências, com a ajuda de fórmulas aritméticas, é transformada em um número. Além disso, apenas as freqüências são enroladas, e os próprios estados (que, aliás, também podem ter suas medidas) são interessantes apenas do ponto de vista de seu número total.

Em ter.faith existe uma operação similar, grosso modo, os sistemas mo são contados de forma similar. Mas somente ali as probabilidades dos estados são multiplicadas com suas medidas, somadas e um número obtido, sobre o qual então os teoremas sobre convergência são provados, etc. Aqui não é assim. Aqui a própria freqüência (chamada sua probabilidade), ou melhor, seu logaritmo, atua como uma medida. O logaritmo resolve alguns problemas aritméticos que Shannon formulou em três condições (deve crescer monotonicamente, etc.).

Depois disso, Shannon diz: -Amigos, vocês sabem, eu inventei regras razoáveis e óbvias sobre como vocês podem somar os números que descobri recentemente, que eu chamo de entropia, a partir de duas tabulações diferentes. Amigos (principalmente militares) perguntam: - Bem, como você faz isso? - Muito simples. - Shannon lhes responde, piscando seus olhos. - Digamos que uma placa não está ligada a outra, elas são independentes, isso acontece na vida. E neste caso eu tenho um teorema sobre adição de entropia, com um resultado maravilhoso - os números simplesmente somam-se! - Tudo bem, mas e se as placas estiverem conectadas de alguma forma incompreensível? - Aqui é a mesma coisa simples, construir uma grande mesa quadrada a partir das duas mesas iniciais, multiplicar as probabilidades em cada célula. Somamos os números nas células por colunas, somamos as colunas separadamente, construímos uma nova tabela, dividimos uma pela outra, aqui cedo zero, aqui peixe embrulhado... Oops, o resultado é um número, que eu chamo de entropia condicional! O que é interessante, a entropia condicional pode ser calculada tanto da primeira tabela para a segunda, como vice-versa! E para levar em conta esta infeliz dualidade, inventei a entropia mútua total, e é a mesma figura! - É muito mais fácil comparar uma figura com outra, do que entender a essência dos dados das tabelas originais. E é ainda mais fácil quando se trata de entender o significado e a confiabilidade dos relacionamentos - é realmente aborrecido. Cortina.

Isto é o que me parece uma breve história da TI. Compilado de minha própria pesquisa e das reivindicações de um dicionário acadêmico (ver citações anteriores).

Agora, o que é importante. O ponto-chave em toda esta história está escondido na entropia condicional. De fato, se alguém quiser operar com uma figura, não é necessário contar nenhuma informação mútua e outras coisas, basta dominar o método de cálculo da entropia condicional. É ela que dará alguma medida da inter-relação de um com o outro. Assim, é necessário entender que as figuras nas tabelas devem ser "estacionárias" e, além disso, as inter-relações das tabelas devem ser "estacionárias". E além disso, as figuras iniciais nas tabelas devem vir de fontes apropriadas.

Deve-se dizer que existem extensões da TI para o caso das correntes Markov. Parece ser exatamente o que o médico pediu. Mas não, as probabilidades de transição para o mercado não são constantes, devido à não-estacionariedade geral. Além disso, enquanto para a CM não importa como o sistema acabou em seu estado atual, para o mercado é muito importante.

Eu não sei qual é o seu alfabeto de problemas. Eu tenho um sistema de um par de barras separadas por distância de Lag. Uma barra, no passado, é a fonte e a outra é o receptor. Os alfabetos de ambos são idênticos (no que diz respeito aos retornos de barras, é claro).

Claramente, algo semelhante à autocorrelação, mas com uma medida diferente. Minhas objeções são exatamente as mesmas que para o caso CM. E todas as outras, estacionariedade, etc.

SZU. Devo dizer que se você realmente a comercializa (TI) e com sucesso, o que com ela, com objeções. Deixe até mesmo um pé de lebre sobre o monitor, se isso ajudar.

Leia HideYourRichess.

Sim, interessante. De fato, a matriz de freqüência dos estados condicionais de um sistema - sob a hipótese de conectividade - sendo reformulada em termos de entropia condicional, nos dá UMA figura descrevendo a possibilidade de haver alguma determinação de uma variável a partir de outra. Se o PDF em tal matriz inicial é uniforme, então temos a entropia máxima do sistema (claro, eu quis dizer entropia condicional). E se houver irregularidades, a entropia será menor. Como primeira aproximação, podemos fazer com uma figura. Você está certo sobre isso. E a informação mútua para o conjunto de variáveis, separada do receptor por Lag, como Alexey escreveu, já é calculada para fins bastante concretos, ou seja, para fins de seleção de variáveis informativas.

Até agora, eu pessoalmente não negocio usando a TI. Este tópico foi uma "primeira tentativa", eu acho.

HideYourRichess: Вот так выглядит краткая история ТИ в моём исполнении. Составлена по мотивам моих собственных изысканий и утверждений академического словарика (см. цитаты ранее).

Muito interessante. A Shannon fez tal confusão que ainda estamos descobrindo...

Deve-se dizer que existem extensões da TI para casos de cadeias de Markov. Parece ser exatamente o que o médico pediu. Mas não, as probabilidades de transição para o mercado não são constantes, devido à não-estacionariedade geral. Além disso, se para a CM não importa como o sistema se desenvolveu no estado atual, para o mercado ele é muito importante.

Esse é o ponto, o fluxo de retorno não é um processo Markoviano, pois o retorno da barra zero depende fortemente do retorno não apenas da primeira barra, mas também da segunda, terceira, etc. Em todo caso, é assim que o estudo do ramo principal pode ser interpretado diretamente.

ZS. Devo dizer que se você realmente comercializa isto (TI) e com sucesso, então que se lixe, com objeções. Deixe a pata de lebre sobre o monitor, se isso ajudar.

Não, eu não tenho. Mas seria muito interessante desenvolvê-lo em algo comercial. Ouvi da alsu (Alexey desapareceu em algum lugar, desculpe), que ele se lembra vagamente de um programa no canal RBC, no qual apareceu um negociante-retrator que realmente comercializa algo semelhante. E ele apostou muito dinheiro nisso. E ele chama seu sistema de "apanhar ineficiências de mercado".

Há muito tempo eu venho pensando na entropia. Eu até coloquei algo aqui fora. Mas depois foi mais como entropia física estatística, não TI, e se referiu à multimoeda. De qualquer forma, o carma vem sussurrando algo entrópico no meu ouvido há alguns anos, e eu tenho ouvido e tento descobrir o que ele quer de mim...

Esse é o ponto, o fluxo de retorno não é um processo Markoviano, pois o retorno da barra zero depende fortemente do retorno não só da primeira barra, mas também da segunda, terceira, etc. Em todo caso, é assim que o estudo do ramo principal pode ser interpretado diretamente.

Não, eu não negocio. Mas seria muito interessante desenvolver isto em algo comercializável. Ouvi da alsu (Alexey desapareceu em algum lugar, desculpe), que ele se lembra vagamente de um programa no canal RBC, no qual apareceu um negociante-repórter que realmente comercializa algo semelhante. E ele apostou muito dinheiro nisso. E ele chama seu sistema de "apanhar ineficiências de mercado".

E já há muito tempo venho pensando em entropia. E até mesmo afixou algo aqui. Mas depois foi mais como a entropia da física estatística, não da TI, e estava relacionada à multimoeda. De qualquer forma, o carma vem sussurrando algo entrópico no meu ouvido há alguns anos, e eu tenho ouvido e tento descobrir o que ele quer de mim...

Muito curioso.

Mas você poderia, Alexey, formular mais claramente (em sua mesa) a que hipótese sobre a distribuição dos retornos correspondem as estimativas do qui-quadrado?

O "browne" primordial, ou algo mais fresco?

;)