トレーディングにおける機械学習:理論、モデル、実践、アルゴトレーディング - ページ 2820 1...281328142815281628172818281928202821282228232824282528262827...3399 新しいコメント Roman 2022.11.07 15:15 #28191 グラディエント・ブースティング トレインでは、asscgasuは0.85 に上がるが、テストでは0.75に下がる。 assgassuを 上げるオプションとして、 各クラス -1, 0, 1 について、有意な変数の影響を近似してみることが できます。 これらのスプラインを新しい変数として使用 します。 たとえば、クラス1では、RSIの影響は次のようになります 近似して、新しいスプラインを得た。 その結果、新しいスプラインの集合が得られ、それを元の変数の代わりに入力に与える。 mytarmailS 2022.11.07 17:54 #28192 Roman #:グラデーション・ブースティングの場合、ゲインは0.85 まで上昇 したが、テストでは0.75 まで低下した。 asssugasuを 上げるオプションとして、 各クラス-1, 0, 1 これらのスプラインを新しい変数として使う ために、有意な変数の効果を近似してみる ことができる。たとえば、クラス1では、RSIの影響は次のようになります近似すると、新しいスプラインが得られる。 その結果、新しいスプラインのセットが得られ、それを元の変数の代わりに入力に与える。よくやった! 私はxgboostで0.83を得ましたが、他の変数からすでにohlcとdonchian channelを取り、変数間のすべての可能な関係を構築しました。しかし、重要な符号を持つ変数は300ほどあった。近似を使った面白いアイデアだ。面白い。0.9を絞り出せたら、クールだと思う。=======自動フィーチャービルダーを作りたいのですが、コードアーキテクチャがまとまりません...。要するに爆弾になるはずなんだけど、それは理論上の話。=======モデルのトレーニングは何でやるんですか? Roman 2022.11.07 19:42 #28193 mytarmailS #:それは称賛に値するね! 僕はxgboostで0.83を得たんだけど、他の変数からohlcとdonchian channelを取って、変数間の可能な関係をすべて構築したんだ。 しかし、重要な符号を持つ変数は300ほどあった。 近似を使った面白いアイデアだ。面白い。 0.9を絞り出せたら、クールだと思う。 ======= 自動フィーチャービルダーを作りたいのですが、コードアーキテクチャに頭が回りません......。 要するに爆弾のようなものなのだろうが、それは理論上の話であって......。 ======= モデルのトレーニングは? これらの例では、変数間のすべての可能な関係が自動的に設定されました。 それらを無効にしたり、関係に特定の変数を設定することもできますが。 私は近似なしでチューニングをプレイし、ツリーあたりのノード数を変数の数に増やしました。 モデルはより複雑になり、12分間訓練しました。 トラインのassugasuは0.97 に上昇 しましたが、テストは0.74ですべてを台無しにしました。 一般的には、取り組んで考えるべきことがあるのだろう。プログラムにはいろいろな設定がありますが、どのように操作すればいいのかよく理解 できていません。昨日から自分で機能を勉強しているところです。 ))機能を勉強するために、たまたまあなたのデータセットが出てきただけです。まあ、あなたのデータから何か出てくるかもしれません。 自動特徴ビルダーの意味がよく理解できません。 特徴そのものを自動検索するのか、それとも既存の特徴間の関係を自動検索するのか? mytarmailS 2022.11.07 19:56 #28194 Roman #:これらの例では、変数間の可能なすべての関係が自動的に設定されています。 ただし、これらを無効にしたり、特定の変数に関係を設定したりすることもできます。 いいえ、そういう意味ではありません。 新しいデータで akurasi 0.83 を得るために、他の特徴で xgboost を訓練したという意味です。 OHLCと別のインジケータから特徴を構築した。 原則に従って O[i] - H[i-1] L[i-5]-指標[i-10]。 ........ .... .. というように、すべての可能な組み合わせ(すべてとすべて)。 私は約1万形質を得た。 そのうち300個が有用であった。 モデルは新しいデータで 0. 83を与えた =========== ローマン"自動特徴ビルダー"って どういう意味ですか? 私は上記のようなことを自動化して、コンピュータ自身が特徴量を構築するようにしたいのですが、その場合、選択できる特徴量は1万ではなく、例えば10億になります。 ローマ字で: 機能そのものを自動検索するのですか、それとも利用可能な機能間の依存関係を自動検索するのですか? 特徴の自動生成/構築 ---> 適性のテスト ---> 最良のものの選択 ---> 最良のものの突然変異でさらに良いものを探す......。 そして、それはすべて自動で行われる。MSUAを読んだことがあるのなら、MSUAに基づいている......しかし、それに基づいていない......。 Machine learning in trading: DoEasyライブラリの時系列(第38部): 時系列コレクション-リアルタイムの更新とプログラムからのデータへのアクセス DoEasyライブラリのグラフィックス(第80部): 「幾何学的アニメーションフレーム」オブジェクトクラス Aleksey Vyazmikin 2022.11.07 21:21 #28195 Roman #:プログレにはいろいろな設定があるんだけど、その使い方がよくわからないんだ。昨日から自分で機能を勉強しているところなんだ ))ところで、あなたのデータセットは、機能を勉強するためのもので、まあ、たぶん、あなたのデータから何か、絞り出す ことができるだろう。 このプログラムは何ですか? Maxim Dmitrievsky 2022.11.07 21:43 #28196 ターゲットと属性に関する結論はHMMと同じである。これらの結論がどこから来るのかは不明である。 mytarmailS 2022.11.08 10:31 #28197 近接性と確率が同じものだと考えているバカでない人は、それがわかっていない......。 Maxim Dmitrievsky 2022.11.08 10:52 #28198 専門学校で教えないのは、数学的にはどんな行列も同じ😀😀😀であり、それに対する演算も同じだということだ。クラスタの定義と名前のアルゴリズムだけが違う。 mytarmailS 2022.11.08 10:57 #28199 そう、数学的にはどんな行列も同じであり、したがって近接性と確率は同じである))))。恥をかかないようにね、学生じゃないんだから。 Maxim Dmitrievsky 2022.11.08 11:12 #28200 幾何 確率を読む彼は本当に切り株で、すべての言葉にしがみついている。 あなたは完全な認知性ジストロフィーで、何について議論することさえできないの? 1...281328142815281628172818281928202821282228232824282528262827...3399 新しいコメント 理由: キャンセル 取引の機会を逃しています。 無料取引アプリ 8千を超えるシグナルをコピー 金融ニュースで金融マーケットを探索 新規登録 ログイン スペースを含まないラテン文字 このメールにパスワードが送信されます エラーが発生しました Googleでログイン WebサイトポリシーおよびMQL5.COM利用規約に同意します。 新規登録 MQL5.com WebサイトへのログインにCookieの使用を許可します。 ログインするには、ブラウザで必要な設定を有効にしてください。 ログイン/パスワードをお忘れですか? Googleでログイン

グラディエント・ブースティング

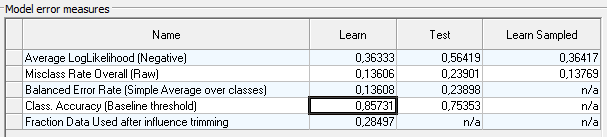

トレインでは、asscgasuは0.85

に上がるが、テストでは0.75に下がる。

assgassuを 上げるオプションとして、 各クラス -1, 0, 1

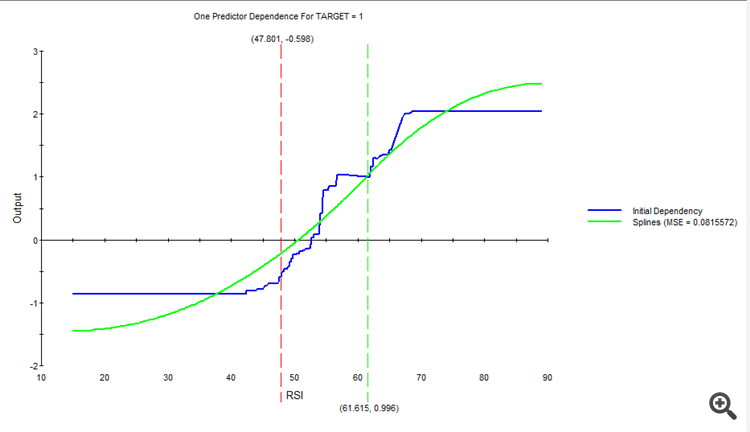

について、有意な変数の影響を近似してみることが できます。 これらのスプラインを新しい変数として使用 します。

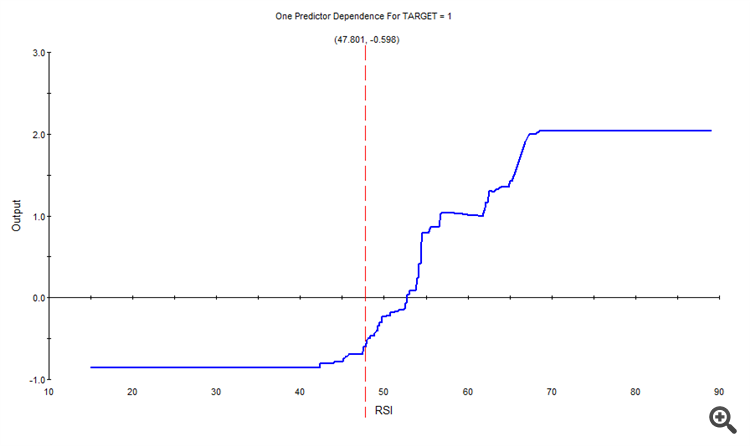

たとえば、クラス1では、RSIの影響は次のようになります

近似して、新しいスプラインを得た。

その結果、新しいスプラインの集合が得られ、それを元の変数の代わりに入力に与える。

グラデーション・ブースティング

の場合、ゲインは0.85

まで上昇 したが、テストでは0.75

まで低下した。

asssugasuを 上げるオプションとして、 各クラス-1, 0, 1

これらのスプラインを新しい変数として使う ために、有意な変数の効果を近似してみる ことができる。

たとえば、クラス1では、RSIの影響は次のようになります

近似すると、新しいスプラインが得られる。

その結果、新しいスプラインのセットが得られ、それを元の変数の代わりに入力に与える。

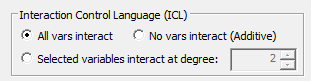

これらの例では、変数間のすべての可能な関係が自動的に設定されました。

それらを無効にしたり、関係に特定の変数を設定することもできますが。

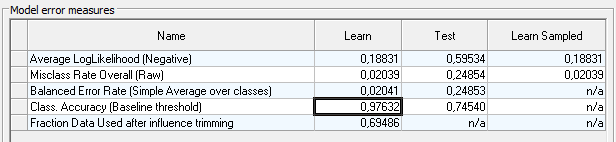

私は近似なしでチューニングをプレイし、ツリーあたりのノード数を変数の数に増やしました。

モデルはより複雑になり、12分間訓練しました。

トラインのassugasuは0.97

に上昇 しましたが、テストは0.74ですべてを台無しにしました。

一般的には、取り組んで考えるべきことがあるのだろう。

プログラムにはいろいろな設定がありますが、どのように操作すればいいのかよく理解 できていません。

昨日から自分で機能を勉強しているところです。 ))

機能を勉強するために、たまたまあなたのデータセットが出てきただけです。まあ、あなたのデータから何か出てくるかもしれません。

自動特徴ビルダーの意味がよく理解できません。

特徴そのものを自動検索するのか、それとも既存の特徴間の関係を自動検索するのか?

これらの例では、変数間の可能なすべての関係が自動的に設定されています。

ただし、これらを無効にしたり、特定の変数に関係を設定したりすることもできます。

いいえ、そういう意味ではありません。

新しいデータで akurasi 0.83 を得るために、他の特徴で xgboost を訓練したという意味です。

OHLCと別のインジケータから特徴を構築した。

原則に従って

O[i] - H[i-1]

L[i-5]-指標[i-10]。

........

....

..

というように、すべての可能な組み合わせ(すべてとすべて)。

私は約1万形質を得た。

そのうち300個が有用であった。

モデルは新しいデータで 0. 83を与えた

===========

"自動特徴ビルダー"って どういう意味ですか?

私は上記のようなことを自動化して、コンピュータ自身が特徴量を構築するようにしたいのですが、その場合、選択できる特徴量は1万ではなく、例えば10億になります。

機能そのものを自動検索するのですか、それとも利用可能な機能間の依存関係を自動検索するのですか?

特徴の自動生成/構築 ---> 適性のテスト ---> 最良のものの選択 ---> 最良のものの突然変異でさらに良いものを探す......。

そして、それはすべて自動で行われる。

MSUAを読んだことがあるのなら、MSUAに基づいている......しかし、それに基づいていない......。

プログレにはいろいろな設定があるんだけど、その使い方がよくわからないんだ。

昨日から自分で機能を勉強しているところなんだ ))

ところで、あなたのデータセットは、機能を勉強するためのもので、まあ、たぶん、あなたのデータから何か、絞り出す ことができるだろう。

このプログラムは何ですか?

幾何 確率を読む

彼は本当に切り株で、すべての言葉にしがみついている。

あなたは完全な認知性ジストロフィーで、何について議論することさえできないの?