Машинное обучение в трейдинге: теория, модели, практика и алготорговля - страница 951

Вы упускаете торговые возможности:

- Бесплатные приложения для трейдинга

- 8 000+ сигналов для копирования

- Экономические новости для анализа финансовых рынков

Регистрация

Вход

Вы принимаете политику сайта и условия использования

Если у вас нет учетной записи, зарегистрируйтесь

Вот допишу ещё пару предикторов и перейду к ансамблям.... и начнутся тогда бубны с плясками.

лучше не начинать )) беспонтовый отстой

когда в голове нет стратегии и нет фундаментального одтверждения что оно вообще может работать, то все это курвафиттинг

отбирай пердикторы не отбирай, перебирай модели не пер... этому можно посвятить вечность

осознавая в полной мере это явление, я просто сделал курвафиттера и регуляризатор. Жрет все подряд на вход, выплевывает на ООС рандомную фигню, но после регуляризации работает какое-то время

лучше не начинать )) беспонтовый отстой

когда в голове нет стратегии и нет фундаментального одтверждения что оно вообще может работать, то все это курвафиттинг

отбирай пердикторы не отбирай, перебирай модели не пер...

Вот не надо, если советник работает на этих данных нормально, то есть закономерности, которые в нём описаны, и не важно подгонка или нет, так и пусть на них выйдет модель МО, хотя бы!

Вот не надо, если советник работает на этих данных нормально, то есть закономерности, которые в нём описаны, и не важно подгонка или нет, так и пусть на них выйдет модель МО, хотя бы!

Осознание это сложная вещь, которая приходит через страдания

Осознание это сложная вещь, которая приходит через страдания

Осознание того, что МО не может повторить четкую логику алгоритма?

Осознание того, что МО не может повторить четкую логику алгоритма?

а в этом вообще нет смысла никакого

а в этом вообще нет смысла никакого

Тогда да, я разочарован.

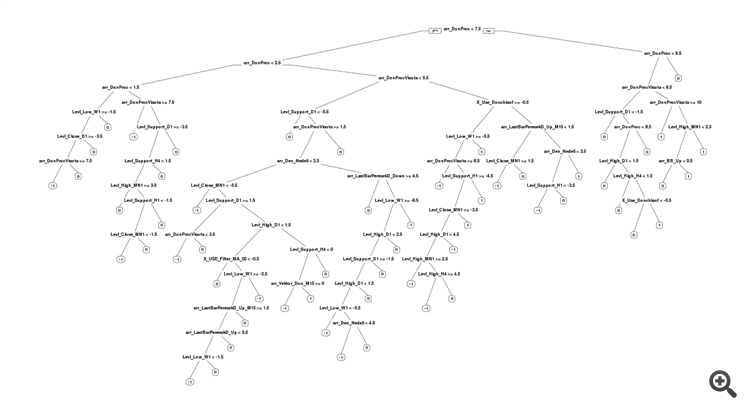

Для последнего файла у меня так вышло с деревом :

2016, тренировка

2015, тест:

при предсказании "-1": -1 фактически будет встречаться немного чаще чем 1. Но 0 будет чаще всех, и наверное это всё закончится убытками. Аналогично для класса "1".

С деревом вышла беда. Генетика выбрала параметр дерева ср = 0, а это даёт дереву разрешение на кучу ветвей. Неудачно вышло, нужно было ограничить этот параметр каким-то малым ненулевым значением.

Я думаю что в данных недостаточно предикторов для классификации "0". Нужны какие-то индикаторы флэта например.

В общем плохо с деревом. У СанСаныча с лесом вот гораздо круче вышло.

Что это переобучение, неверные настройки, кардинально другой рынок?

Плохие настройки модели, и как следствие - переобучение.

У СанСаныча с лесом вот гораздо круче вышло.

Какая там крутизна - переобучение и больше ничего, у него нет НИ одного предиктора, который бы относился к его целевой переменной - сплошной шум. Причем сидит в rattle и вместо того чтобы проверить на шум, выкладывает здесь файлы с мусором.