В данной статье, обсудим начало экспериментов с созданием нейронной сети, которая оптимальным образом подходила бы для работы на валютном рынке. Основной недостаток классических НС заключается в их статической/статистической природе, когда модель обучается на исторических данных и, впоследствии, рыночные закономерности меняются, а нейросеть...

为什么,不,有太多的树......即使有10棵也很好(我不记得我设置了多少棵)。

500个是很多的,对任何数据集来说都足够了

为什么小数会出现这样的错误? ......奇怪,我以为机器可以准确地学习......因此,在模式的情况下(在外汇中),它们的形式是很不明确的(像乘法表),如果你在60%的情况下得到正确的预测就很好。

错误发生的原因是r参数很低,这意味着只有一半的例子被用于训练,而这一半的例子是在一半的树上训练的:)而且例子很少。

你必须设置r~1才准确。用于假定性和对袋外样品的测试

只是这个机制需要调整,在森林的情况下,只有两个设置

你也应该明白,NS(RF)不是一个计算器,但它近似于一个函数,对于许多任务来说,太高的精度是弊大于利的。

我担心网络上的回归/预测会产生与在历史上寻找类似的网站/模式差不多的结果(我3个月前就这样做了)。

错误发生的原因是r参数很低,这意味着只有一半的例子被用于训练,而这一半的例子是在一半的树上训练的:)而且例子很少。

你必须设置r~1才准确。用于假定性和对袋外样品的测试

你只需要知道如何调整这个机制,在森林的情况下,只有2个设置

也就是说,如果你把r设置为1,那么它将在所有样本上进行训练。

反正森林不会使用所有的属性,所以有一个模型修改,你可以把它设置为使用所有的属性。但不建议这样做,因为森林会记住所有的选项

而设置的选择往往是这样一个主观的事情,你必须进行试验。

如果小于1,则在剩余的样本上验证模型(模型在未被纳入训练样本的数据上进行估计)。经典的r为0.67,则在剩余的33%上验证模型。当然,这对大样本来说是真的,对小样本来说,就像乘法表一样--最好设置为1。

反正森林不会使用所有的属性,所以有一个模型修改,你可以把它设置为使用所有的属性。但不建议这样做,因为森林会记住所有的选项

而设置的选择往往是这样一个主观的事情,你必须进行试验。

如果它小于1,那么在剩下的样本上模型被验证(模型是在没有被纳入训练样本的数据上估计的)。 根据经典的r被设定为0.67,在剩下的33%上模型被验证。

特点选择

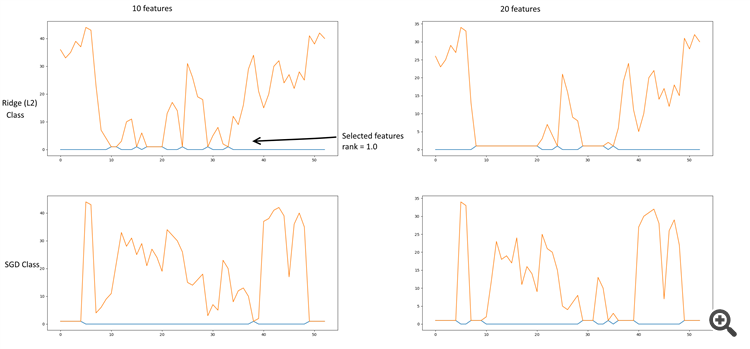

一点点的数据挖掘。我是通过Chi^2+KBest、RFE(递归特征消除)+(SGDClassifier,RidgeClassifier)、L2(Ridge,RidgeClassifier)、L1(Lasso)进行特征选择。山脊正则化给出了更理智的结果。

一些图表。

RFE + Ridge & SGD

Ridge regressor(L2)。

山脊分类器(L2)

该文件包含一个参数值的表格,以及通过特征选择对其进行抽样。

最重要的系数原来是:。

- 10, 11 - 关闭,三角洲(开-关)。

- 18-20 - 衍生品高点、低点、收点

- 24 - 日志衍生关闭

- 29, 30 - Lowess

- 33 - Detranding Close - Lowess

- 35 - EMA 26 (13作为一个选项)

- 40 - 衍生品 EMA 13

PS。表中的Ridge分类器一行是基于一个类,它没有反映出对其他类的参数依赖性。参照 脚本。

勾勒出一个新的网络图,这是第一个描述。以后会有更多(希望如此)。

https://rationatrix.blogspot.ru/2018/01/blog-post.html

勾勒出一个新的网络图,这是第一个描述。以后会有更多(希望如此)。

https://rationatrix.blogspot.ru/2018/01/blog-post.html

我想知道为什么第一个帖子被删除了。他在博客上写下了这个计划。=)