L'apprendimento automatico nel trading: teoria, modelli, pratica e algo-trading - pagina 2819

Ti stai perdendo delle opportunità di trading:

- App di trading gratuite

- Oltre 8.000 segnali per il copy trading

- Notizie economiche per esplorare i mercati finanziari

Registrazione

Accedi

Accetti la politica del sito e le condizioni d’uso

Se non hai un account, registrati

Qualsiasi clustering o classificatore ha una matrice di probabilità, transizioni o distanze. I cosiddetti valori grezzi. E ci sono le etichette delle classi e dei cluster. Sta confrontando cose diverse.

Sì, ma non è completamente accurato. È il modo in cui preferisco descrivere lo stato attuale e prevedere il futuro. Questi compiti sono essenzialmente gli stessi. Un cambiamento di stato è una previsione, anche se una descrizione dello stato attuale))))

Sì, ma non è completamente preciso. È il modo in cui preferisco descrivere lo stato attuale e prevedere il futuro. Questi compiti sono essenzialmente gli stessi. Un cambiamento di stato è una previsione, anche se una descrizione dello stato attuale))))

È inequivocabile. Finché ci sarà un confronto tra un'opa e un dito, non parteciperò più al dialogo. D'altronde non l'ho iniziato io.

Essenzialmente la probabilità futura e il clustering di stati sono la stessa cosa, qual è la differenza?

Essenzialmente la probabilità futura e il clustering degli stati sono gli stessi, qual è la differenza?

Sta diventando difficile, vero? Probabilità grezze senza soglia vs cluster già con soglia

In realtà, c'è una somiglianza, una linea è una media di modelli, sì, più è meno, e come caratterizzare il movimento? Solo in base alla distanza percorsa, e la distanza è solo quella più piccola, cioè una griglia. Sì, le entità discrete sono più complicate di quelle continue, ma quello che abbiamo è quello con cui lavoriamo)).

Preferisco vedere un giocattolo in streaming. Cos'altro c'è da fare di sabato?

https://www.twitch.tv/gamearbuser

Ho un figlio che lavora part-time come commentatore alle gare di comp)))). Beh, e anche nella vita reale sul kart e sui pattini))))))

Ho un figlio che lavora part-time come commentatore alle gare di competizione)))). Beh, e nella vita reale anche sul kart e sui pattini)))))

Lasciategli trasmettere come pattina) raccoglierà le donazioni in seguito.

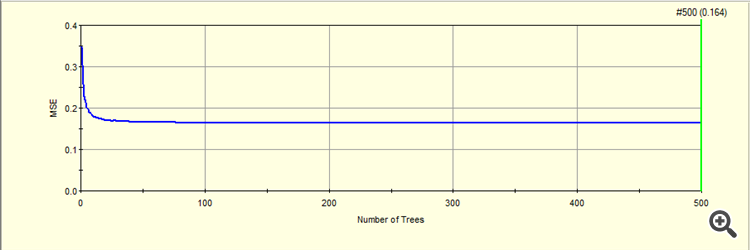

data stabilita

le prime 10 informazioni sui prezzi delle azioni, se si desidera creare nuove funzioni, altrimenti devono essere rimosse dalla formazione.

ultima riga - obiettivo

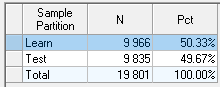

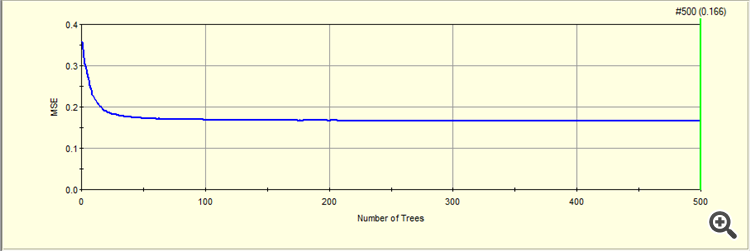

dividere la selezione a metà per l'addestramento e il test

su Forrest senza alcuna messa a punto ottengo sui nuovi dati

su hgbusta con le nuove caratteristiche, ottengo Akurashi 0,83.

Mi chiedo se sia possibile ottenere 0,9 Akurasi?

Nessuno l'ha mai toccato? (

Io l'ho toccato solo per divertimento).

Usato Random forest.

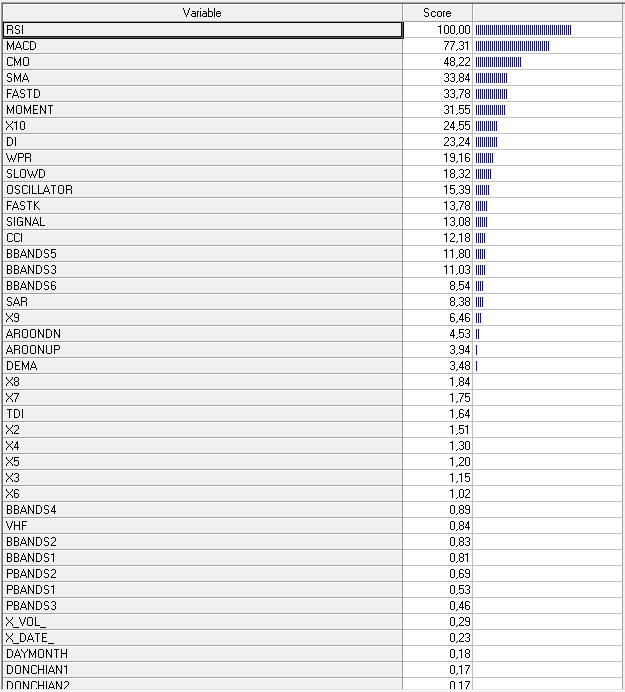

Variabili non utilizzate:

X_OI

X_PER

X_TICKER

Come richiesto, treyne e test a metà.

Ho limitato il numero massimo di alberi cresciuti a 500.

MSE su traina per 500 alberi cresciuti

MSE su test per 500 alberi cresciuti

La metrica risultante su traine(OOB) e su test.

Qui non so come portare l'accuratezza 0 ,77 della foresta casuale a questa metrica.

Probabilmente si dovrebbe sottrarre l'MSE da uno,

1- 0,16 = 0,84

Poi si ottiene l'accuratezza che si ha su XGBoost )).

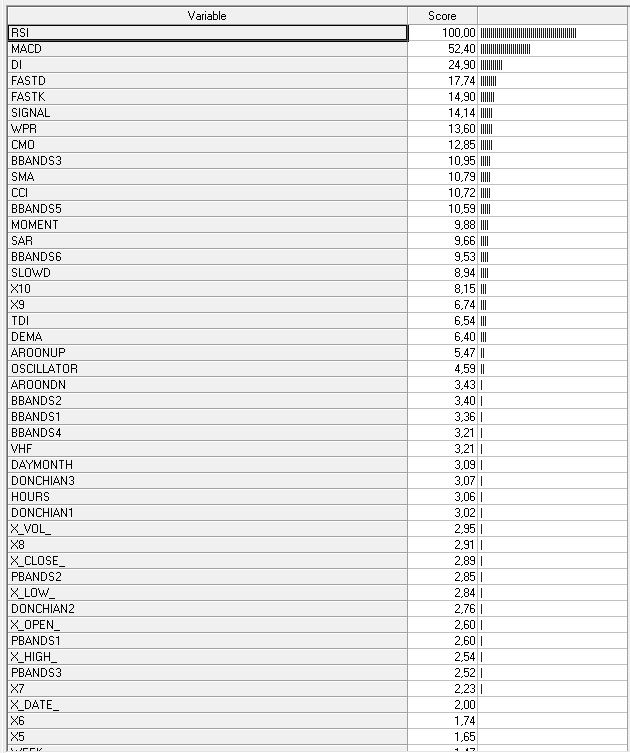

E le variabili che contribuiscono all'addestramento.

Questo è il tipo di analisi che ho ottenuto )

L'ho toccato solo per divertimento)

Usato Foresta casuale.

Variabili non utilizzate:

X_OI

X_PER

X_TICKER

Come richiesto, traccia e test a metà.

Probabilmente anche i prezzi assoluti OHLC dovrebbero essere buttati via) come ho scritto)

MSE su trayne per 500 alberi cresciuti

MSE su test per 500 alberi cresciuti

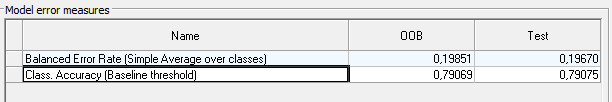

La metrica risultante su trayne (OOB) e su test.

Qui non so come portare la precisione 0 ,77 della foresta casuale a questa metrica.

Probabilmente l'MSE dovrebbe essere sottratto da uno,

Stai facendo una regressione, stai facendo una classificazione! Hai sbagliato tutto.

Mentre scrivo, i prezzi assoluti di OHLC dovrebbero essere buttati via)

Stai facendo una regressione, dovresti fare una classificazione! Hai sbagliato tutto

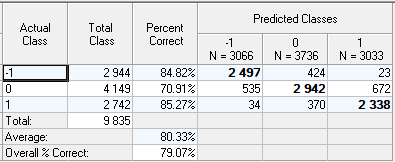

Ecco la classificazione, senza OHLC.

L'accuratezza è 0,79.

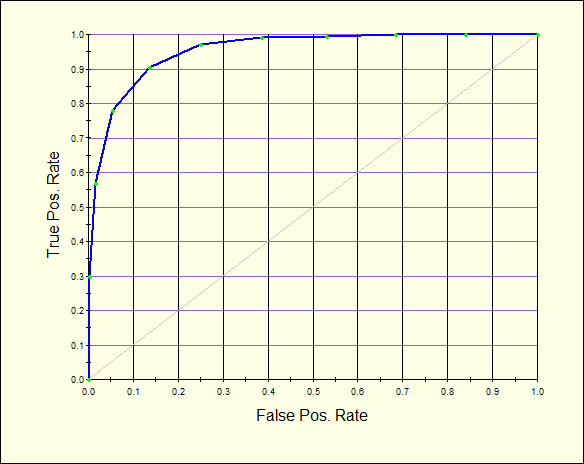

Test ROC.

Matrice di confusione.

Variabili d'influenza