В данной статье, обсудим начало экспериментов с созданием нейронной сети, которая оптимальным образом подходила бы для работы на валютном рынке. Основной недостаток классических НС заключается в их статической/статистической природе, когда модель обучается на исторических данных и, впоследствии, рыночные закономерности меняются, а нейросеть...

なんでやねん、木が多すぎるやろ...10本でも大丈夫やったのに(何本設定したか忘れました)

500は、あらゆるデータセットに十分な量です。

なぜ分数でこのようなエラーが出るのでしょうか? ...不思議ですね、機械が正確に学習してくれると思っていたのですが...。だから、(FXの)パターンの場合、その形がはっきりしない(掛け算の表のような)ので、60%の確率で予想が当たればいいわけです。

エラーが発生したのは、rパラメータが低かったためです。つまり、学習には半分の例しか使われておらず、この半分は半分の木で学習されています :) そして、例数が少ないのです

を設定する必要があります。擬似正規化、袋から出したサンプルのテストに使用します

ただ、この機構は調整が必要で、森の場合、2つの設定しかありません。

また、NS(RF)は電卓ではなく、関数を近似するものであり、精度が高すぎることは多くの作業において良いことよりも悪いことであることを理解する必要があります。

ネットで回帰・予測しても、歴史の中で似たようなサイト・パターンを探すのと同じ程度のものが出てきそうで怖いです(3ヶ月前にやりましたけど)。

エラーが発生したのは、rパラメータが低かったためです。つまり、学習には半分の例しか使われておらず、この半分は半分の木で学習されています :) そして、例数が少ないのです

を設定する必要があります。擬似正規化、袋から出したサンプルのテストに使用します

この機構をどのようにチューニングするか、森の場合、2つの設定しかありません

つまり、rを1に設定すれば、すべてのサンプルで学習されることになります。

フォレストはどうせすべての属性を使わないので、すべての属性を使うように設定できるモデル修正があります。しかし、これは森がすべてのオプションを記憶してしまうので、お勧めできません

また、設定の選択は主観的なことが多いので、実験する必要があります。

classic r が 0.67 であれば,残りの33%でモデルを検証する.もちろん、これは大きなサンプルの場合であって、小さなサンプルの場合は掛け算の表と同じで、1を設定した方が良い。

フォレストはどうせすべての属性を使わないので、すべての属性を使うように設定できるモデル修正があります。しかし、これは森がすべてのオプションを記憶してしまうので、お勧めできません

また、設定の選択は主観的なことが多いので、実験する必要があります。

1より小さい場合は,残りのサンプルでモデルを検証する(学習サンプルに含まれないデータでモデルを推定する). 古典的な方法では,rは0.67に設定され,残りの33%でモデルが検証される.

機能選択

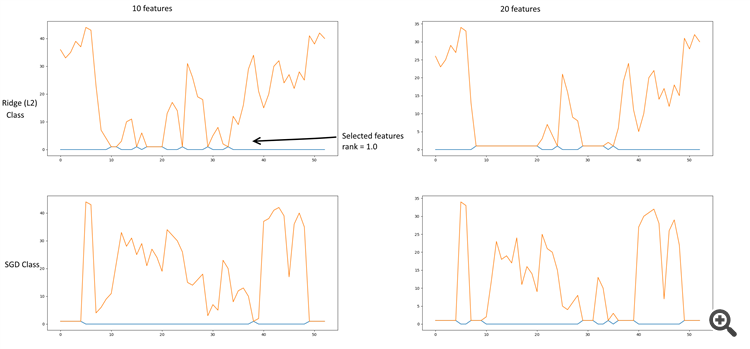

データマイニングをちょっとだけChi^2 + KBest, RFE (Recursive feature elimination) + (SGDClassifier, RidgeClassifier), L2 (Ridge, RidgeClassifier), L1 (Lasso) で特徴選択を行っていました。リッジ正則化により、よりまともな結果が得られる。

一部グラフを掲載しています。

RFE+リッジ&SGD

リッジレグレッサー(L2)。

リッジクラシファイア(L2)

このファイルには、パラメータ値の表と、特徴選択によるサンプリングが含まれています。

最も有意な係数が判明した。

- 10、11 - クローズ、デルタ(オープン-クローズ)

- 18-20 - デリバティブ高値、安値、終値

- 24 - ログデリバティブを閉じる

- 29、30 - Lowess

- 33 - Detranding Close(デトランディング・クローズ) - Lowess(ローウェス

- 35 - EMA 26 (オプションで13)

- 40 - デリバティブEMA 13

PS.表中のRidge Classifierの行は、1つのクラスに基づいており、他のクラスへのパラメータ依存は反映されていません。スクリプトへの参照。

は、新しいネットワーク図をスケッチし、これが最初の記述です。後日談があります(希望的観測)

https://rationatrix.blogspot.ru/2018/01/blog-post.html

は、新しいネットワーク図をスケッチし、これが最初の記述です。後日談があります(希望的観測)

https://rationatrix.blogspot.ru/2018/01/blog-post.html

最初の投稿が削除されたのはなぜだろう。そのスキームをブログで紹介した。=)