L'apprentissage automatique dans la négociation : théorie, modèles, pratique et algo-trading - page 626

Vous manquez des opportunités de trading :

- Applications de trading gratuites

- Plus de 8 000 signaux à copier

- Actualités économiques pour explorer les marchés financiers

Inscription

Se connecter

Vous acceptez la politique du site Web et les conditions d'utilisation

Si vous n'avez pas de compte, veuillez vous inscrire

Pourquoi, non, il y a trop d'arbres... c'était bien même avec 10 (je ne me souviens plus combien j'en ai mis)

500, c'est beaucoup, assez pour n'importe quel ensemble de données.

Pourquoi a-t-il échoué sur les nombres fractionnaires ? ... étrange, je m'attendais à ce que la machine puisse apprendre exactement... Ainsi, dans le cas de modèles (en forex) dont la forme est loin d'être claire (comme une table de multiplication), il est bon d'obtenir des prédictions correctes dans 60% des cas.

Les erreurs se sont produites parce que le paramètre r était faible, ce qui signifie que seule la moitié des exemples a été utilisée pour l'entraînement, et cette moitié a été entraînée sur la moitié des arbres :) et il y a peu d'exemples.

vous devez régler r~1 pour être exact. Utilisé pour la pseudo-régularisation et pour les tests sur les échantillons hors sac.

c'est juste que ce mécanisme doit être ajusté, dans le cas de la forêt, il y a seulement 2 réglages

Vous devez également comprendre que NS (RF) n'est pas une calculatrice, mais qu'il approxime une fonction, et qu'une précision trop élevée est plus mauvaise que bonne pour de nombreuses tâches.

J'ai peur que la régression/prévision sur le net produise à peu près la même chose que la recherche de sites/modèles similaires dans l'histoire (ce que j'ai fait il y a 3 mois) :

Les erreurs se sont produites parce que le paramètre r était faible, ce qui signifie que seule la moitié des exemples a été utilisée pour l'entraînement, et cette moitié a été entraînée sur la moitié des arbres :) et il y a peu d'exemples.

vous devez définir r~1 pour être exact. Utilisé pour la pseudo-régularisation et pour les tests sur les échantillons hors sac.

Il faut juste savoir comment régler ce mécanisme, dans le cas de la forêt, il n'y a que 2 paramètres

Par exemple, si vous définissez r à 1, il sera entraîné sur tous les échantillons.

La forêt n'utilisera pas tous les attributs de toute façon, il y a donc une modification du modèle où vous pouvez le configurer pour utiliser tous les attributs. Mais ce n'est pas recommandé car la forêt se souviendra de toutes les options.

et le choix des paramètres est souvent très subjectif, vous devez expérimenter.

Si elle est inférieure à 1, alors le modèle est validé sur les échantillons restants (le modèle est estimé sur les données qui n'ont pas été prises dans l'échantillon d'entraînement). r classique est 0.67, sur les 33% restants le modèle est validé. Bien sûr, cela est vrai pour les grands échantillons, pour les petits, c'est comme avec la table de multiplication - il vaut mieux mettre 1.

La forêt n'utilisera pas tous les attributs de toute façon, il y a donc une modification du modèle où vous pouvez le configurer pour utiliser tous les attributs. Mais ce n'est pas recommandé car la forêt se souviendra de toutes les options.

et le choix des paramètres est souvent très subjectif, vous devez expérimenter.

S'il est inférieur à 1, alors le modèle est validé sur les échantillons restants (le modèle est estimé sur les données qui n'ont pas été prises dans l'échantillon d'entraînement). Selon la méthode classique, r est fixé à 0,67, le modèle est validé sur les 33% restants

Sélection des caractéristiques

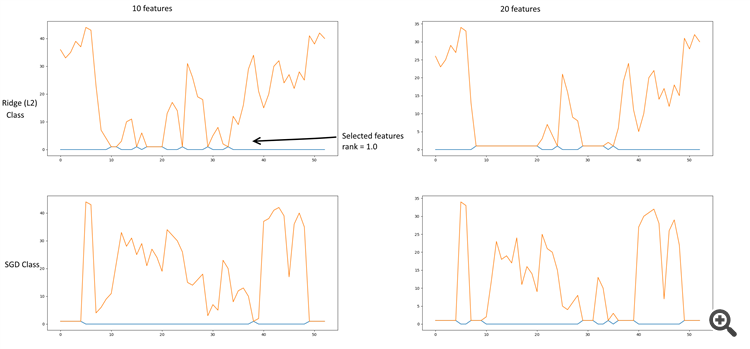

Un peu de datamining. Je faisais la sélection des caractéristiques via Chi^2 + KBest, RFE (Recursive feature elimination) + (SGDClassifier, RidgeClassifier), L2 (Ridge, RidgeClassifier), L1 (Lasso). La régularisation des crêtes donne des résultats plus sains.

Quelques graphiques :

RFE + Ridge & SGD

Régresseur de crête (L2).

Classificateur en crête (L2)

Le fichier contient un tableau des valeurs des paramètres, et leur échantillonnage par sélection de caractéristiques.

Les coefficients les plus significatifs se sont avérés être :

- 10, 11 - Fermer, Delta (Ouvrir-Fermer)

- 18-20 - Dérivés haut, bas, clôture

- 24 - Fermeture du dérivé du journal

- 29, 30 - Lowess

- 33 - Detranding Close - Lowess

- 35 - EMA 26 (13 en option)

- 40 - Dérivés EMA 13

PS. La ligne Ridge Classifier dans le tableau est basée sur une classe, elle ne reflète pas les dépendances des paramètres sur les autres classes.Référence au script.

a esquissé un nouveau diagramme de réseau, c'est la première description. Il y en aura d'autres plus tard (avec un peu de chance)

https://rationatrix.blogspot.ru/2018/01/blog-post.html

a esquissé un nouveau diagramme de réseau, c'est la première description. Il y en aura d'autres plus tard (avec un peu de chance)

https://rationatrix.blogspot.ru/2018/01/blog-post.html

Je me demande pourquoi le premier message a été supprimé. Il a blogué le projet. =)