Проделана огромная работа. Затрачено, уверен, море времени. Цель какая этой серии статей?

Если упражнение в программировании на МКЛ5 - понятно, нужно. Каждый может попробовать что это за зверь. К сожалению многие могут разочароваться низкими результатами Ваших реализаций и отказаться от дальнейшего поиска в этой области.

В практическом плане время обучения больше 2 часов(!) неприемлемо. Для этого разработаны море программ на различных языках, различными крупными организациями. Только применяй правильно.

Удачи

Проделана огромная работа. Затрачено, уверен, море времени. Цель какая этой серии статей?

Если упражнение в программировании на МКЛ5 - понятно, нужно. Каждый может попробовать что это за зверь. К сожалению многие могут разочароваться низкими результатами Ваших реализаций и отказаться от дальнейшего поиска в этой области.

В практическом плане время обучения больше 2 часов(!) неприемлемо. Для этого разработаны море программ на различных языках, различными крупными организациями. Только применяй правильно.

Удачи

Добрый день, Владимир.

Цель статей - продемонстрировать возможности и дать инструмент всем желающим для построения своих программ.

Обучение одной эпохи больше 2 часов еще и без использования многопоточности видеокарт - это вполне приемлемый результат. На практике обучается нейронная сеть на подготовленных данных, а работаем на реальных данных с отработкой одного текущего состояния за доли секунд.

Согласен, в примерах показан низкий результат, но перед статьей и не ставилась цель дать всем желающим готовый советник с некой доходностью. Для этого помимо самого инструмента необходима длительная работа по архитектуре нейронной сети, сопровождающаяся рядом эскпериментов с различными архитектурами нейронных сетей.

там получается не 2 часа, а 2 дня :)

а размер выборки какой? сколько признаков и кол-во сэмплов

там получается не 2 часа, а 2 дня :)

а размер выборки какой? сколько признаков и кол-во сэмплов

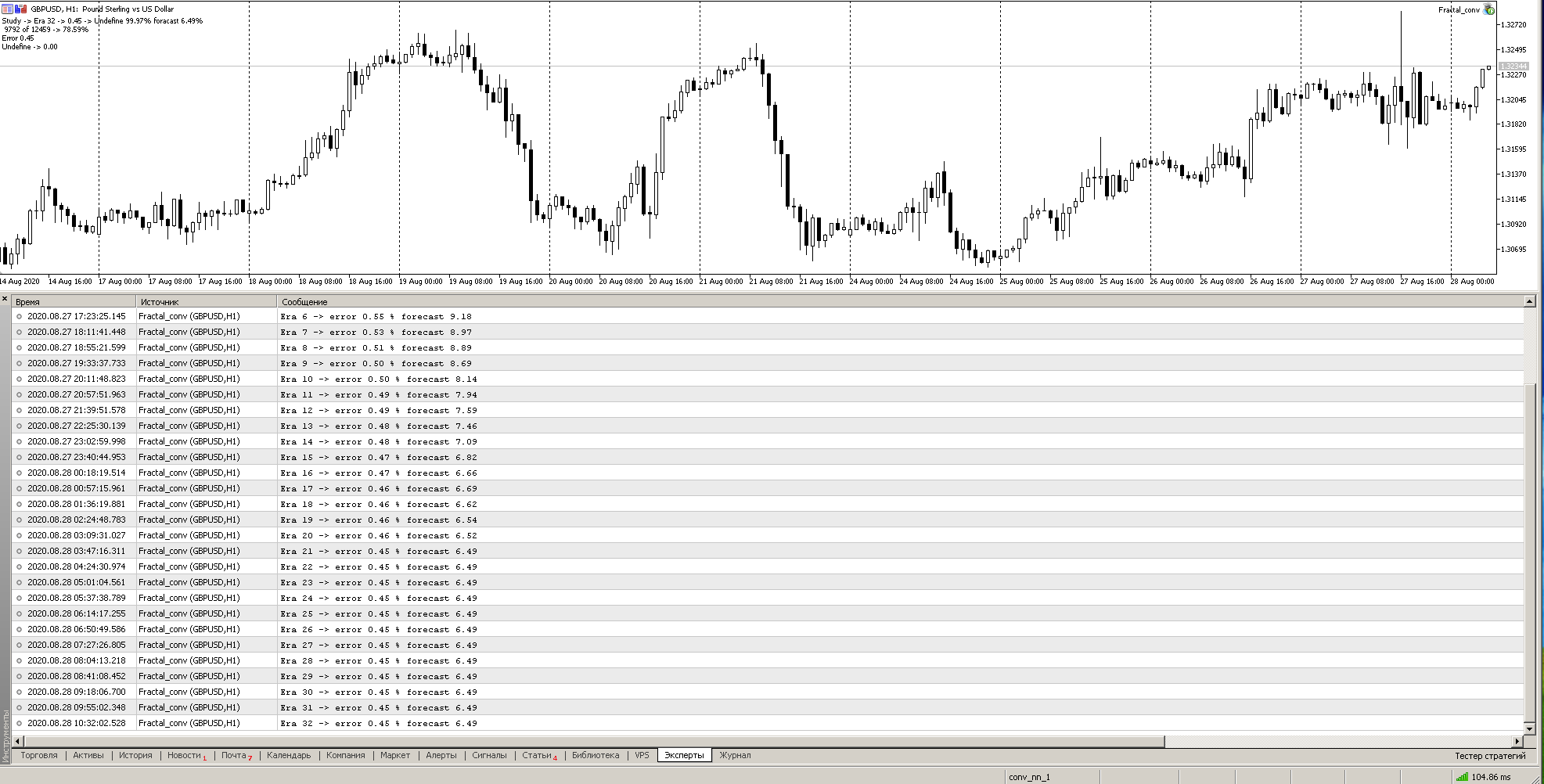

Выборка 12453 свечи (H1 за 2 года). На вход сети подается информация за 20 свечей по 12 признаков на свечу. Время обучения одной эпохи 2-2,5 часа.

Hi Dimitriy!

Thanks for this series of articles about Neural Networks! I really enjoy reading these articles (by google translation into English) as I have also implemented Neural Networks with back-propagation and different techniques of optimization (such as Adam, RMSprop, etc.) in MQL5 language. To be honest, the MQL5 language is too slow for training non-toy problems but such implementations are still valuable. Despite the educational aspect of implementing Neural Networks, we notice that we are not limited to MQL5 programming language to train a network. We can use high performance packages to train a network and then transfer the weights (and other hyper-parameters) into our MQL5 programs to test and trade live. Please continue publishing your good work! :)

Best regards, Rasoul

Hi Dimitriy!

Thanks for this series of articles about Neural Networks! I really enjoy reading these articles (by google translation into English) as I have also implemented Neural Networks with back-propagation and different techniques of optimization (such as Adam, RMSprop, etc.) in MQL5 language. To be honest, the MQL5 language is too slow for training non-toy problems but such implementations are still valuable. Despite the educational aspect of implementing Neural Networks, we notice that we are not limited to MQL5 programming language to train a network. We can use high performance packages to train a network and then transfer the weights (and other hyper-parameters) into our MQL5 programs to test and trade live. Please continue publishing your good work! :)

Best regards, Rasoul

Thanks.

- Бесплатные приложения для трейдинга

- 8 000+ сигналов для копирования

- Экономические новости для анализа финансовых рынков

Вы принимаете политику сайта и условия использования

Опубликована статья Нейросети — это просто (Часть 3): Сверточные сети:

Продолжая тему нейронных сетей, предлагаю рассмотреть сверточные нейронные сети. Данный тип нейронных сетей был разработан для поиска объектов на изображении. Рассмотрим, как он может нам помочь в работе на финансовых рынках.

Тестирование проводилось на паре EURUSD период H1. В одном терминале на разных графиках одного инструмента одновременно было запущено 2 советника: со сверточной и полносвязной нейронной сетью. Параметры полносвязных слоев сверточной нейронной сети аналогичны полносвязной сети второго советника, т. е. к ранее построенной сети мы только добавили сверточный и подвыборочный слои.

Визуально можно заметить, что на графике сверточной нейронной сети сигналы появляются реже, но ближе к цели.

Автор: Dmitriy Gizlyk