"New Neural" è un progetto di motore di rete neurale Open Source per la piattaforma MetaTrader 5. - pagina 9

Ti stai perdendo delle opportunità di trading:

- App di trading gratuite

- Oltre 8.000 segnali per il copy trading

- Notizie economiche per esplorare i mercati finanziari

Registrazione

Accedi

Accetti la politica del sito e le condizioni d’uso

Se non hai un account, registrati

Non può essere così. Diversi tipi in diversi strati. Si potrebbe anche fare di ogni neurone uno strato separato.

Per quanto riguarda il buffer, vi faccio un esempio. Lasciami tornare a casa.

Uno strato è un'unione di neuroni indipendenti l'uno dall'altro in un'iterazione.

Chi dice che non può essere, ma io voglio, ma mi stai tagliando le ali :o)

Non si sa mai cosa possono inventarsi le persone, e dire loro che tutti i neuroni in uno strato devono avere lo stesso numero di ingressi.

Tutti dovrebbero essere diversi anche per i neuroni dello stesso strato, altrimenti otterremo solo un mucchio di algoritmi (molti dei quali su Internet) che devono essere ombreggiati per legare qualcosa.

SZY Quanto sarebbe più difficile l'algoritmo se ogni neurone avesse uno strato separato?

Chi può consigliarmi qualche software di disegno online per diagrammi e cose del genere?

Google Docs ha dei disegni, puoi condividerli.

Posso fare qualche lavoro di disegno part-time, purché non sia più di 1 ora al giorno.

OK, per me, 4 delle reti implementate sono interessanti

1. Reti di Kohonen, compresa la SOM. Buono da usare per il partizionamento dei cluster dove non è chiaro cosa cercare. Penso che la topologia sia ben nota: vettore come ingresso, vettore come uscita o comunque uscite raggruppate. L'apprendimento può avvenire con o senza un insegnante.

2. MLP, nella sua forma più generale, cioè con un insieme arbitrario di strati organizzati come un grafo con feedback. Usato molto ampiamente.

3. Rete di ricircolo. Francamente, non ho mai visto una buona implementazione non lineare funzionante. È usato per la compressione delle informazioni e l'estrazione dei componenti principali (PCA). Nella sua forma lineare più semplice, è rappresentata come una rete lineare a due strati in cui il segnale può essere propagato da entrambi i lati (o tre strati nella sua forma dispiegata).

Rete 4.Echo. Simile in principio a MLP, applicato anche lì. Ma totalmente diverso nell'organizzazione e ha un tempo di apprendimento ben definito (bene, e produce sempre un minimo globale, a differenza).

5. PNN -- Non l'ho usato, non so come. Ma penso che troverò qualcuno che lo fa.

6. Modelli per la logica fuzzy (da non confondere con le reti probabilistiche). Non implementato. Ma può essere utile. Se qualcuno trova informazioni lanciare plz. Quasi tutti i modelli hanno la paternità giapponese. Quasi tutti sono costruiti manualmente, ma se fosse possibile automatizzare la costruzione della topologia tramite espressioni logiche(se ricordo tutto correttamente), sarebbe irrealisticamente bello.

+ reti con aumento evolutivo del numero di neuroni o viceversa.

+ aloritmi genetici + metodi di accelerazione dell'apprendimento.

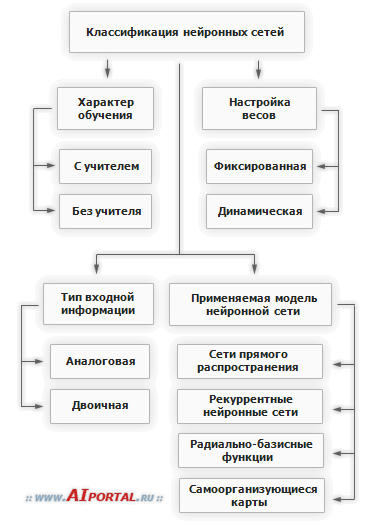

Ho trovato una piccola classificazione come questa

+ aloritmi genetici

La genetica divora un sacco di risorse extra. Gli algoritmi a gradiente sono migliori.

Perché decidere per gli utenti di cosa hanno bisogno? Dovete dare loro una scelta. PNN, per esempio, mangia anche molte risorse.

La libreria dovrebbe essere universale e vasta, permettendo di trovare varianti di soluzioni e non in set di backpropagation standard, che si possono trovare sul web.

Uno strato è un'unione di neuroni indipendenti l'uno dall'altro in un'iterazione.

Che senso ha?

Non si sa mai cosa possono inventarsi le persone, e dire loro che tutti i neuroni del livello devono avere lo stesso numero di ingressi.

Ogni neurone ha un ingresso e un'uscita.

Tutti i tipi e le connessioni possono essere diversi anche per i neuroni dello stesso strato, questo dovrebbe essere preso in considerazione, altrimenti otterremo solo un mucchio di algoritmi (molti di loro su Internet), che devono essere modellati per collegare qualcosa.

Prima di tutto, non ho finito. In secondo luogo, vedere le regole. Le critiche dopo. Non vedi il modello nel suo insieme e inizi a criticare. Questo non va bene.

SZY Quanto sarebbe più difficile l'algoritmo se ogni neurone avesse uno strato separato?

Algoritmo per cosa? Rallenterebbe solo l'apprendimento e il funzionamento.

E cos'è esattamente un'entità "tampone"?

Il buffer è l'entità attraverso la quale le sinapsi e i neuroni comunicano. Ancora una volta, il mio modello è molto diverso da quello biologico.

_____________________

Scusa se non l'ho finito ieri. Dimenticato di pagare per internet, è stato tagliato fuori :)

Uno strato è un'unione di neuroni indipendenti l'uno dall'altro in una singola iterazione.

Chi dice che non può essere, ma io voglio, ma mi stai tagliando le ali :o)

Non so cosa si possa inventare, si può dire che tutti i neuroni di uno strato devono avere lo stesso numero di ingressi.

E i tipi e le connessioni possono essere tutti diversi anche per i neuroni di uno strato, da questo dobbiamo basarci, altrimenti otterremo solo un mucchio di algoritmi (molti in Internet) di cui dobbiamo cercare qualcosa da collegare.

SZY Quanto sarebbe più difficile l'algoritmo se ogni neurone avesse uno strato separato?

Teoricamente è probabilmente possibile, in pratica non mi sono imbattuto in una cosa del genere. Anche con l'idea per la prima volta.

Penso che, puramente a scopo sperimentale, si può pensare alla sua implementazione, nel quadro dell'implementazione del progetto di uno strato "vario" non è probabilmente la migliore idea in termini di costi del lavoro e di efficienza di implementazione.

Anche se personalmente mi piace l'idea, almeno una tale possibilità potrebbe valere la pena di essere discussa.

Perché decidere per gli utenti di cosa hanno bisogno?

? La genetica è un metodo di apprendimento. La cosa giusta da fare, imho, è nascondere gli algoritmi di apprendimento, scegliendo prima il migliore.

? La genetica è un metodo di apprendimento. Più corretto imho seppellire gli algoritmi di apprendimento, preselezionando quello ottimale.

Lavorare con il NS significa solo scegliere la sua topologia? Anche il metodo di allenamento gioca un ruolo importante. La topologia e l'apprendimento sono strettamente legati.

Tutti gli utenti hanno il loro imho, quindi non si può togliere loro metà del processo decisionale.

Abbiamo bisogno di creareun costruttore di reti che non sia limitato da alcun preset. E il più universale possibile.

sergeev:

La libreria dovrebbe essere universale e vasta, aprendo la porta a varianti di soluzioni, non nel set standard di backpropagation, che si può trovare comunque sul web.

Lavorare con il NS significa solo scegliere la sua topologia? Anche il metodo di allenamento gioca un ruolo importante. La topologia e l'apprendimento sono strettamente legati.

Tutti gli utenti hanno il loro imho, quindi non puoi prendere metà della decisione su di te.

Abbiamo bisogno di creareun costruttore di reti che non sia limitato a nessun preset. E il più universale possibile.